Descubre qué es Apache Airflow, cómo funciona, cómo instalarlo y aplicarlo en proyectos. Revisa ejemplos, casos de uso y ventajas de la herramienta.

Organizar tareas en proyectos de datos ya es algo complicado, pero se vuelve aún más difícil cuando hay dependencias entre ellas, plazos específicos y necesidad de monitoreo continuo. Por eso muchos gestores recurren a Apache Airflow, una herramienta utilizada para orquestación de workflows que mejora y facilita mucho este proceso.

Dado que permite que los profesionales del área definan, programen y sigan los flujos de trabajo de manera estructurada, asegurando que cada etapa ocurra en el momento adecuado y en las condiciones previstas.

Para ayudarte con estas demandas, en esta publicación, vamos a abordar los puntos principales sobre esta plataforma: qué es exactamente Apache Airflow, cómo opera a través de una estructura basada en DAGs y scripts de Python, y cómo instalarlo. Disfruta del contenido y ten una excelente lectura.

¿Qué es Apache Airflow?

Apache Airflow es una herramienta de orquestación de flujos de trabajo, con ella es posible programar, monitorear y gestionar tareas de manera controlada.

Su principal objetivo es asegurar que los procesos interdependientes ocurran en el orden correcto y bajo condiciones definidas, lo que es muy importante en situaciones que involucran el tratamiento y manejo de datos a gran escala.

Esta herramienta se destaca por ofrecer una forma estructurada de manejar flujos de trabajo que, muchas veces, necesitan ser repetidos diariamente o en horarios específicos, con un alto nivel de confiabilidad.

Por ser altamente configurable, Airflow satisface tanto demandas simples, como la ejecución de scripts en secuencia, como escenarios más complejos, que involucran múltiples integraciones, programaciones dinámicas y monitoreo continuo.

Definição e histórico

Apache Airflow es una plataforma de código abierto utilizada para programar, monitorear y gestionar flujos de trabajo.

La herramienta fue creada en 2014 por ingenieros de datos de Airbnb, con el objetivo de ofrecer una solución más robusta para organizar tareas que necesitaban suceder en secuencia o en paralelo, de manera controlada.

Desde entonces, se convirtió en un proyecto de la Apache Software Foundation y comenzó a ser muy utilizado por empresas de tecnología y equipos de ingeniería de datos.

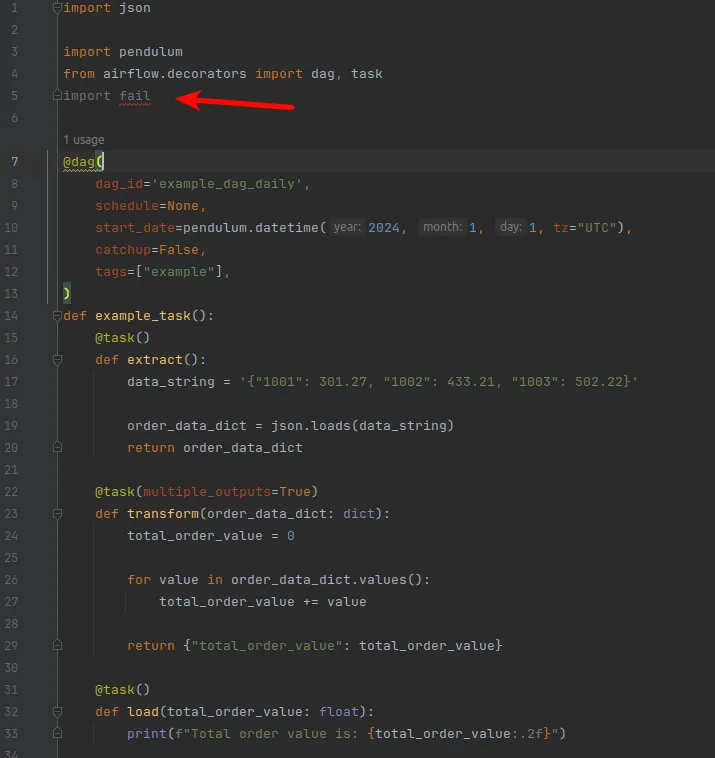

Su arquitectura se basa en DAGs (grafos acíclicos dirigidos), y su configuración se realiza mediante scripts escritos en Python.

Como funciona (DAGs e programação em Python)

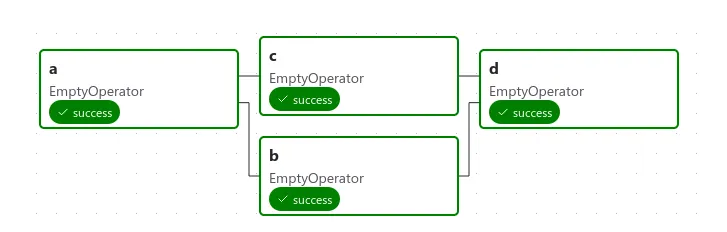

El funcionamiento de Apache Airflow se basa en el uso de DAGs, que representan la secuencia y la relación entre las tareas a ejecutar. Cada DAG define una estructura de dependencia entre las tareas, asegurando que se realicen en el orden correcto y bajo ciertas condiciones.

Estas definiciones están escritas en Python, lo que proporciona flexibilidad y control sobre los procesos. Este modelo permite que el usuario configure desde tareas simples hasta flujos más complejos de manera programable.

Sin embargo, a pesar de tener muchas ventajas, esto también requiere cierto conocimiento técnico, que puede representar un desafío para quienes están comenzando en el área de TI.

Principais características

Entre los principales recursos de Apache Airflow se encuentran:

- Escalabilidad;

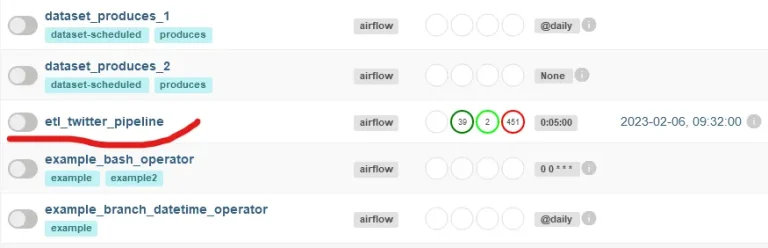

- Posibilidad de seguir ejecuciones a través de una interfaz visual;

- Integración con diversas herramientas y servicios como bases de datos, de almacenamiento y plataformas en la nube.

La herramienta también ofrece soporte para programaciones flexibles, manejo de errores, notificaciones y reutilización de componentes, lo que facilita la gestión de flujos recurrentes.

Ventajas y desventajas de Apache Airflow

Como toda tecnología, Apache Airflow presenta puntos fuertes y limitaciones que deben ser considerados antes de su adopción.

De esta manera, evaluar estas características con claridad es fundamental para entender si la herramienta satisface las necesidades específicas de un proyecto o del equipo involucrado. Vea más detalles a continuación:

| Ventajas | Desventajas |

|---|---|

| Flexible | Curva de aprendizaje |

| Escalable | Configuración inicial compleja |

| Interfaz visual | Requiere mantenimiento constante |

| Buena documentación | Requisitos técnicos |

| Amplia integración | Sobrecarga en proyectos pequeños |

Dependiendo de la estructura disponible, del volumen de datos y del nivel de madurez técnica de los profesionales, el uso de Airflow puede traer excelentes resultados o requerir cuidados adicionales para funcionar de manera eficiente.

Vantagens

Una de las grandes cualidades de Apache Airflow es su flexibilidad, permitiendo que los flujos de trabajo se adapten de acuerdo con la realidad de cada proyecto.

También se destaca por su escalabilidad, siendo capaz de atender desde pequeñas rutinas hasta operaciones más robustas y distribuidas.

La interfaz visual facilita el seguimiento de las ejecuciones, y la documentación extensa contribuye al aprendizaje continuo y la resolución de dudas.

Además, la herramienta ofrece soporte para diversas integraciones con sistemas de almacenamiento, bases de datos, servicios en la nube y otros componentes muy utilizados en entornos de datos.

Desvantagens

Uno de los principales desafíos al utilizar Airflow es la curva de aprendizaje, es decir, el tiempo y el esfuerzo necesarios para dominar su funcionamiento suelen ser largos, y esto puede ser un obstáculo para quienes están empezando.

Esto sucede principalmente para aquellos que aún no están familiarizados con conceptos como DAGs (grafos acíclicos dirigidos), que son la base de Airflow, o con el lenguaje Python, que se utiliza para definir los flujos de trabajo. Además de la curva técnica, la configuración inicial también puede ser desafiante.

Airflow ofrece mucha flexibilidad, pero eso significa que es necesario definir correctamente las variables de entorno, conexiones, dependencias, permisos y otros detalles que garantizan el funcionamiento estable del sistema. Porque si estos puntos no se ajustan bien, la herramienta puede generar fallas difíciles de diagnosticar.

Finalmente, también es importante destacar que mantener el Airflow requiere monitoreo constante y mantenimiento regular. Las actualizaciones de versión, los ajustes en los flujos, la verificación de logs y el rendimiento son parte de la rutina, requiriendo la dedicación de profesionales con un mínimo dominio de la herramienta.

Cómo instalar Apache Airflow

Antes de salir copiando y pegando comandos en el terminal, vale la pena revisar algunos puntos importantes para evitar dolores de cabeza:

- Python actualizado: Airflow solo funciona correctamente en las versiones 3.9 hasta 3.12. Si aún tienes una versión de Python más antigua, recomendamos actualizar primero.

- Base de datos: por defecto incluso funciona con SQLite, pero eso es solo para jugar o probar localmente. Para cualquier cosa seria, piensa en usar PostgreSQL (13 a 16) o MySQL 8.0.

- Sistema operativo: si usas Linux o macOS, genial. En Windows también puedes ejecutarlo, pero la experiencia es mucho mejor utilizando WSL2 o contenedores.

- Memoria: reserva al menos 4GB de RAM, porque Airflow no es tan ligero como parece.

Con estos requisitos en mano, la instalación en sí no es complicada. Existen varias formas de hacerlo (a través de pip, Docker, Helm, etc.), y el equipo del proyecto mantiene una guía muy completa y actualizada con todos los pasos. Para no reinventar la rueda, recomiendo seguir directamente el material oficial: Documentación de instalación de Apache Airflow.

Buenas prácticas y pruebas

Cuando los primeros flujos de trabajo están funcionando en Apache Airflow, es común que el enfoque inicial sea simplemente “hacerlo funcionar”.

Pero, a medida que los proyectos crecen y las dependencias se multiplican, la falta de organización puede generar tareas que fallan sin motivo claro, dificultad para entender lo que se hizo semanas atrás y un tiempo cada vez mayor gastado para corregir pequeños problemas.

Por eso, si adoptas buenas prácticas desde el principio, además de evitar este escenario, hace posible escalar, colaborar y mantener los proyectos funcionando con previsibilidad, mayor agilidad y menos errores e imprevistos.

Estrutura recomendada de DAGs

Para garantizar la legibilidad y la organización del proyecto, es importante que cada DAG siga una estructura clara y estandarizada. Usar nombres descriptivos, que indiquen el propósito de la DAG y de sus tareas, facilita la identificación y el monitoreo.

Además, debes mantener las definiciones separadas por archivos y usar funciones modulares permite reutilizar fragmentos de código sin duplicaciones.

esto hará que el proyecto sea mucho más limpio y escalable, especialmente si hay más de una persona trabajando en el mismo repositorio o cuando los flujos comienzan a crecer en complejidad.

Testes unitários e o comando airflow tasks test

Durante el desarrollo, realizar pruebas unitarias en las tareas es una forma efectiva de validar comportamientos antes de la ejecución completa de la DAG.

El comando airflow tasks test permite simular la ejecución de una tarea aislada en una fecha específica, sin necesidad de iniciar el programador o esperar la programación.

Esto ayuda a identificar errores rápidamente, probar funciones específicas y validar integraciones de manera controlada.

Además, acelera el ciclo de desarrollo y reduce los fallos en la producción. Pero si necesitas un entorno aún más completo y aislado para pruebas y desarrollo, Airflow Breeze es una buena alternativa práctica, como veremos a continuación.

Uso do Airflow Breeze para desenvolvimento local

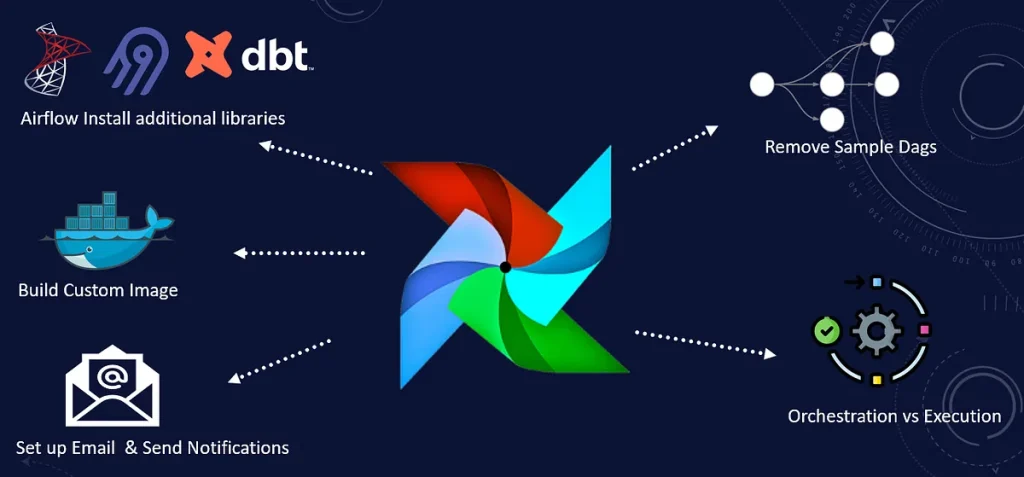

El Airflow Breeze es una herramienta oficial proporcionada por la comunidad de Apache Airflow que simplifica la creación de un entorno de desarrollo local, basado en Docker.

Él automatiza la configuración de dependencias, contenedores y variables, permitiendo que los desarrolladores inicien rápidamente un entorno de pruebas estandarizado.

Además de facilitar la colaboración en equipos, Breeze asegura que todos trabajen bajo las mismas condiciones, lo que reduce las inconsistencias entre diferentes máquinas. Con este soporte, es más fácil aplicar las buenas prácticas vistas hasta ahora.

Casos de uso en ingeniería de datos

En la práctica, Apache Airflow se ha convertido en una pieza clave en la vida cotidiana de los ingenieros de datos. Ya que la herramienta permite crear pipelines que automatizan y organizan procesos complejos de manera visual, estructurada y reutilizable.

| Caso de uso | Cómo ayuda Airflow |

|---|

| Orquestación de ETL | Garantiza que la extracción, transformación y carga ocurran en el orden y en el tiempo correctos, con una visualización clara de cada etapa. |

| Integración con bases de datos y APIs | Conecta y sincroniza datos de múltiples fuentes (SQL, APIs externas) de forma automática y coordinada. |

| Monitoreo y alertas | Proporciona registros detallados, notificaciones e interfaz visual para detectar, corregir y prevenir problemas rápidamente. |

Esto facilita desde tareas simples, como mover datos entre dos sistemas, hasta flujos robustos con varias dependencias y etapas.

Al tratar con grandes volúmenes de datos y múltiples fuentes, la capacidad de orquestar cada paso con control, previsibilidad y visibilidad hace que Airflow sea indispensable.

Orquestração de ETL

Uno de los mayores desafíos en proyectos de datos es asegurar que diferentes partes de un proceso, como recopilar datos, transformarlos y luego enviarlos a un destino, suceden en el orden correcto, en el momento correcto, sin errores en el camino.

Apache Airflow resuelve exactamente eso. Permite crear un flujo lógico y encadenado para estas tareas, ayudando al ingeniero a organizar todo en bloques bien definidos. Con él, es posible visualizar cada etapa del pipeline y entender claramente lo que está funcionando y lo que necesita atención.

Integração com bancos e APIs

En la práctica, los datos que mueven una empresa no están todos en el mismo lugar. Parte de ellos proviene de bancos SQL, otra de servicios externos a través de API, y a menudo es necesario cruzar estas fuentes.

Airflow también permite conectar estos diferentes sistemas de manera coordinada, programando ejecuciones automáticas y controlando lo que sucede en cada llamada.

Esta capacidad de integrar y sincronizar fuentes tan distintas es uno de los motivos que hacen de Airflow una herramienta indispensable en el día a día del ingeniero de datos.

Monitoramento e alertas

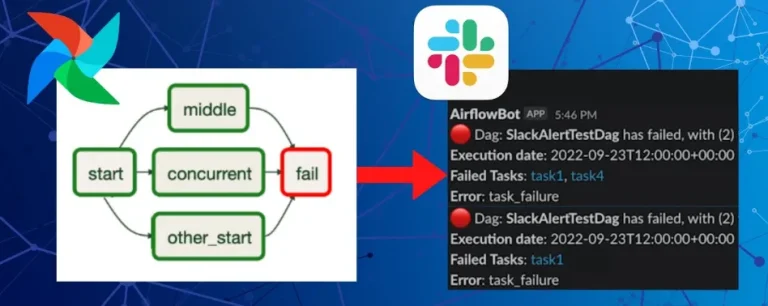

Saber que algo salió mal, cuando salió mal y por qué, este tipo de visibilidad es esencial en cualquier operación de datos.

Apache Airflow ofrece herramientas robustas de monitoreo, con registros detallados (logs), notificaciones automáticas por correo electrónico y una interfaz visual intuitiva para seguir todo en tiempo real.

Esto permite no solo resolver problemas más rápido, sino también prevenir fallos recurrentes. El resultado es una operación más segura, predecible y mucho más eficiente.

Conclusión

Apache Airflow mejora la forma en que manejamos los flujos de trabajo, aportando más organización, automatización y claridad a tareas complejas. En lugar de scripts aislados, ofrece una estructura más confiable y escalable.

Esta practicidad viene acompañada de autonomía. Con Airflow, es posible visualizar y ajustar flujos en tiempo real, lo que reduce fallos, ahorra tiempo y permite enfocarse en lo que realmente importa: generar valor con los datos.

Si este contenido fue útil, continúa aquí en el blog de HostGator. Hay muchas otras publicaciones para aquellos que quieren aprender, probar y aplicar tecnología real en el día a día.

Contenido sugerido: